云在地球-大气系统中扮演着重要的角色🧑🏻🦽➡️,云物理参数如云相态(CLP)、云顶高度(CTH)🦶🏿、云光学厚度(COT)和云有效粒子半径(CER)的准确获取对于极端天气预测预警和气候变化等研究至关重要🧑🏿🦲。卫星遥感是获取云物理参数的最主要手段,目前使用的卫星遥感云产品主要源于太阳同步轨道卫星(极轨卫星)和地球同步轨道卫星(静止卫星)🌑。静止卫星以较高的频次对地球表面约1/3的区域进行连续观测,可以捕捉到云的日变化特征。与之相比,极轨卫星Aqua和Terra搭载的中分辨率光谱成像仪(MODIS)位于较低的轨道高度(约700公里)🔚,能够提供更精确的云遥感数据集。然而MODIS每次过境时只能扫描约2000 km × 2330 km的小范围区域,无法满足更大空间覆盖范围的需求。此外🪈,传统的可见光/短波红外双光谱反演算法虽然可以在白天反演得到云的物理参数,但其对薄云的反演能力明显不足,并且在太阳耀光区无法应用;传统的红外分裂窗和基于红外多通道的最优估计等物理算法虽然可以得到夜间的云物理参数👷🏼♀️,但由于热红外辐射穿透能力弱🫧,在估计光学厚云(COT大于6)的物理参数时存在局限性。

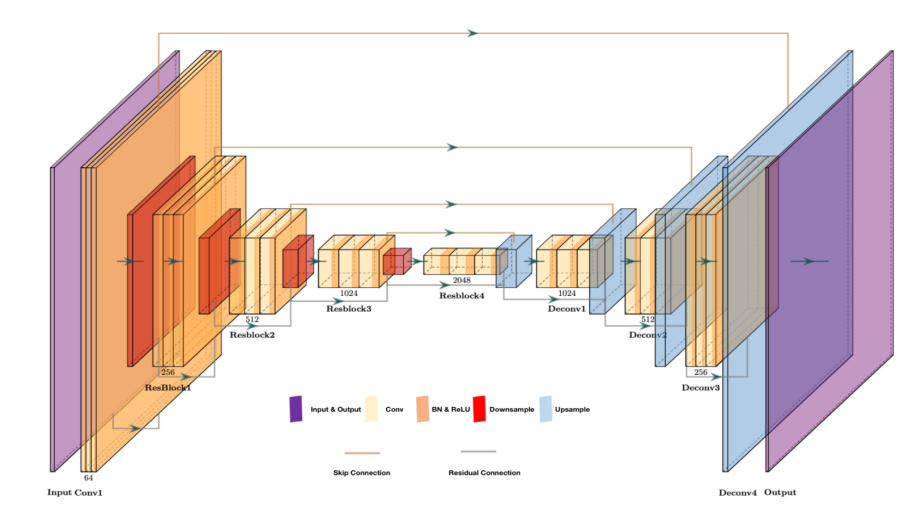

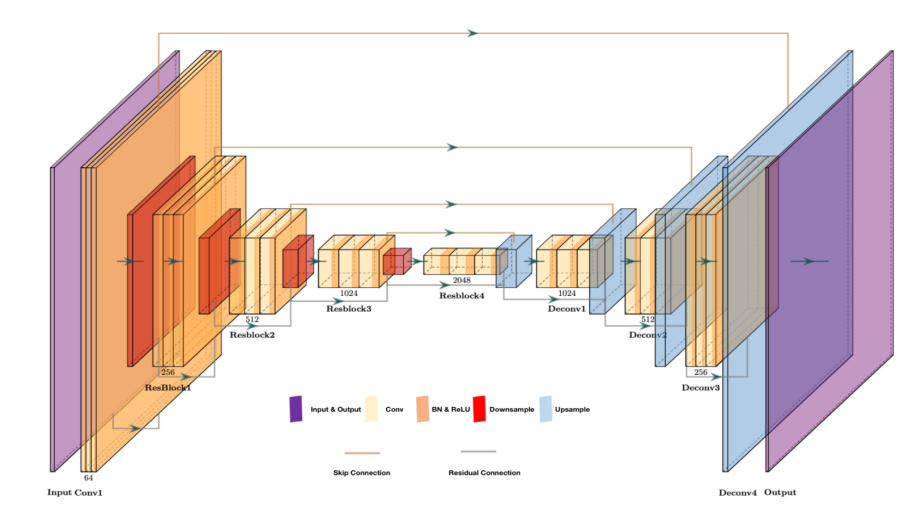

图1. ResUnet结构示意图

为了解决传统物理反演算法在太阳耀光区和夜间存在的反演问题,弥补现有静止卫星官方云产品缺乏光学特性和夜间云产品等缺陷,万事娱乐张峰教授团队利用深度学习模型提出了一种基于图像(包含云空间结构信息)的静止卫星全天时云遥感反演算法🧃。该算法以静止卫星观测的热红外通道亮温和辅助气象场资料作为输入👶🏿🚵🏿♂️,以日本静止卫星Himawari-8(H8)的AHI官方云产品(只有白天)数据作为标签进行训练,建立静止卫星观测亮温等输入特征与云产品之间的面到面映射关系🤴🏽😒,然后将此关系应用在夜间🧑🏼💼♨️,从而发展一套静止卫星全天时云遥感反演算法🧓🏻。与传统的物理反演算法和基于单个像元的机器学习方法相比,该算法在反演精度和效率上均有明显的优势,可在1分钟左右对静止卫星成像仪全圆盘观测区域的云物理参数进行高精度反演。研究中使用的深度学习模型-ResUnet结构框架如图1所示,其主要是由经典的语义分割网络Unet和残差网络Resnet相构成。内部的残差模块和跳跃链接能有效避免和缓解由于网络层数增加而带来的梯度爆炸和梯度消失等问题,在云物理参数的反演中起到了很好的效果🤞🏽。

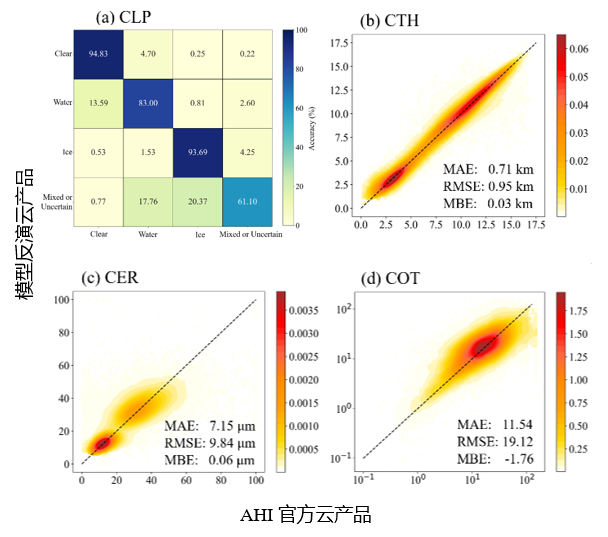

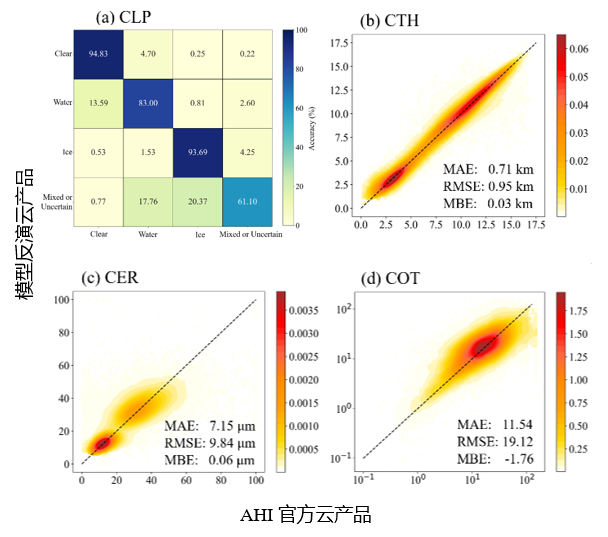

图2. RseUnet模型在测试集上的(a)CLP,(b)CTH,(c)CER和(d)COT反演效果

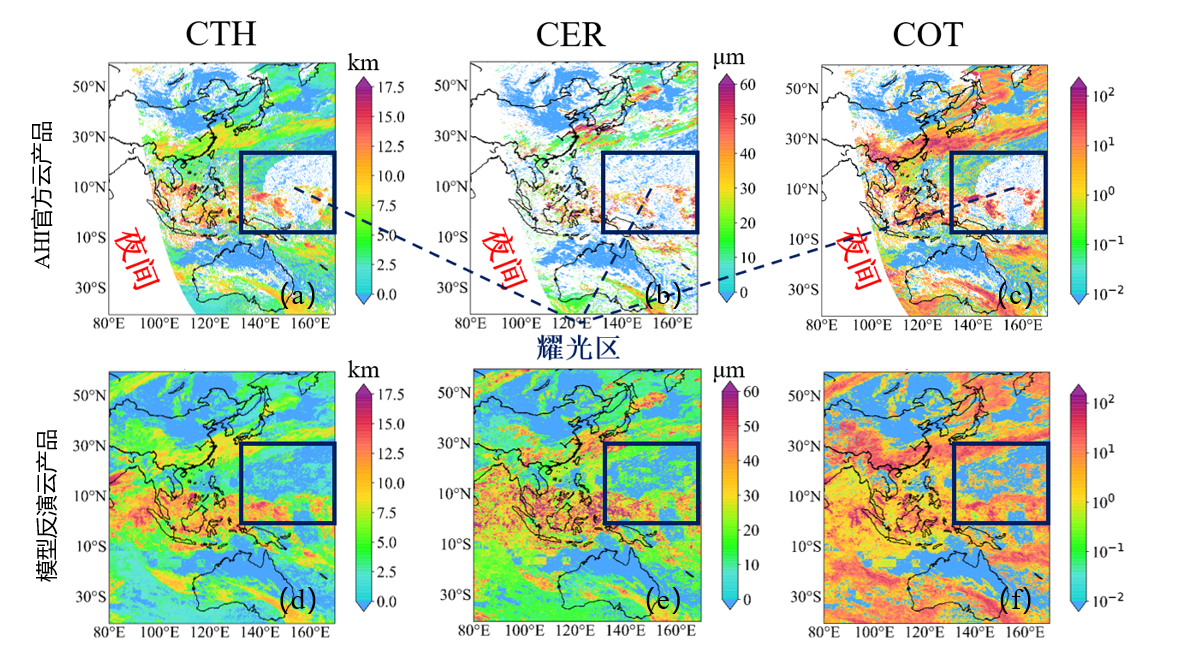

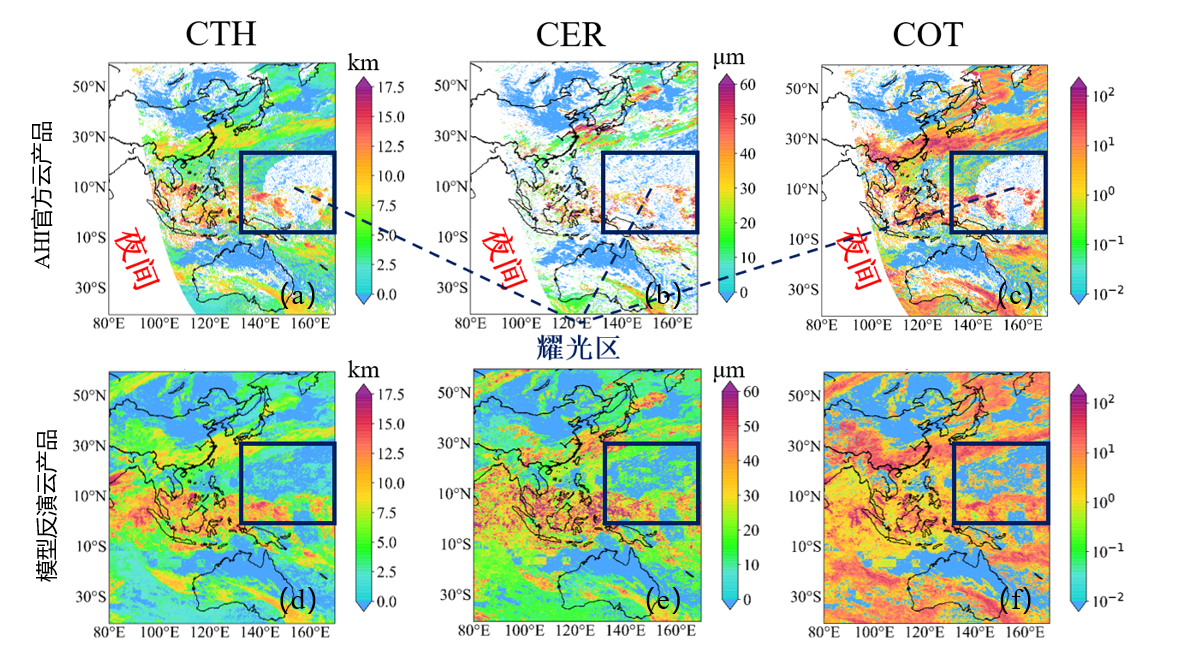

团队将该算法成功应用在了新一代国产静止卫星风云四号(FY4A)/AGRI和日本静止卫星H8/AHI传感器上👩🏼💼,并且都取得了良好的反演效果🍄。下面以FY4A/AGRI上的应用结果为例,展示ResUnet模型在整体精度和空间分布上的表现能力🕉。如图2所示🧝🏻♀️,在独立的测试集上,模型对于CLP识别的总体准确率为90.64%,对CTH,CER和COT反演的均方根误差(RMSE)为0.95km,9.84µm和19.12🧖🏿,这说明ResUnet模型具有良好的云反演能力。此外,从图3所示的AHI官方云产品和ResUnet模型反演的云物理参数空间分布上看,二者之间具有较好的对应关系。在AHI官方云产品的缺测区域🐿,其中包括夜间区域和太阳耀光区域,ResUnet模型均可以反演得到有效的云物理参数👌🏽,并且在空间上具有很好的连续性💂🏽♂️。以上结果说明基于深度学习模型发展的全天时云遥感反演算法可以在太阳耀光区和夜间进行有效的云物理参数反演🚠。此外,由于AGRI官方并未发布全天时的CER和COT产品,所以该算法的发展和应用也很好的弥补了国产静止卫星官方云产品在云微物理特性产品方面的缺陷。

图3. 2020年04月26日UTC_04:00 AHI官方云产品(a-c)和ResUnet模型(d-e)反演的CTH(a和d)🧑🏼🏭, CER (b和e)和COT(c和f)的空间分布图(白色部分为缺测区域)。

虽然该算法在全天时云物理参数的反演方面取得了不错的效果,但由于深度学习模型的反演效果依赖于标签产品的质量和精度,导致该算法反演得到的云产品精度会受限于日本静止卫星H8/AHI官方云产品的精度。为了进一步提升静止卫星云产品的反演精度🛀🏿,张峰团队进一步提出了一种基于图像(包含云空间结构信息)的全天时云遥感反演迁移学习算法。该迁移学习算法首先将上述以静止卫星AHI官方云产品作为标签训练得到的模型作为预训练模型,然后以极轨卫星MODIS官方云产品作为标签进行迁移训练,使得该算法可以充分结合静止卫星观测频次高、观测范围广以及极轨卫星的观测精度高等优势🧘🏿,实现静止卫星的全天时、高精度👲🏼、高频次🖖🏿、大范围云物理参数遥感反演👲。

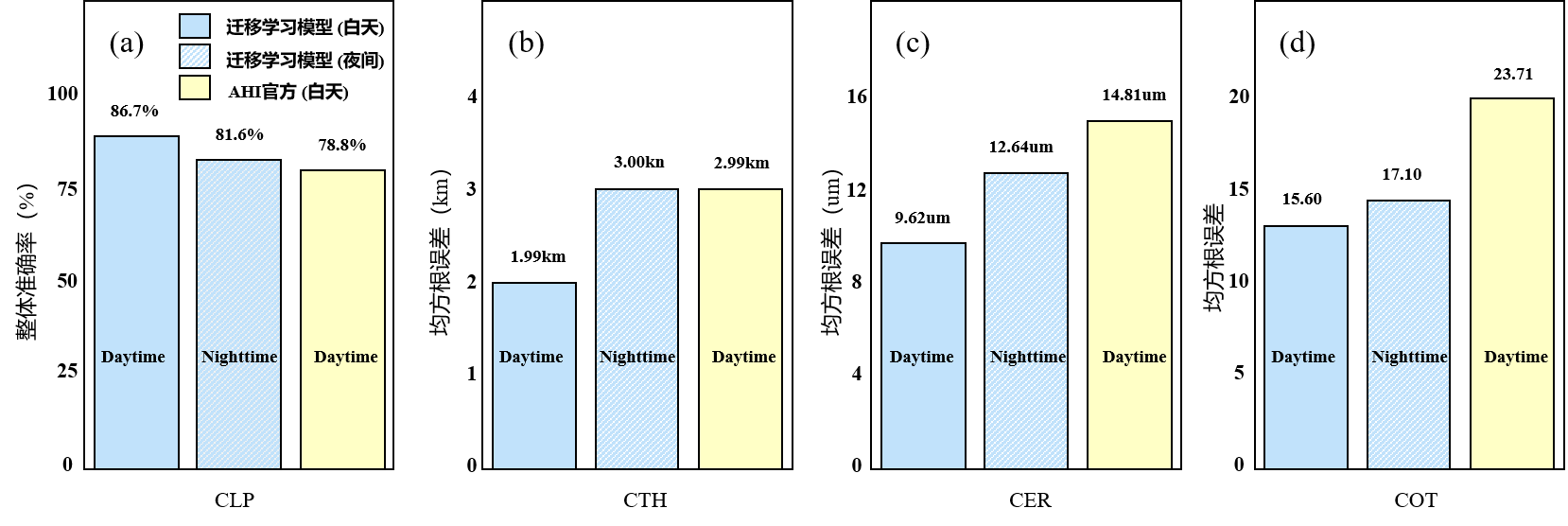

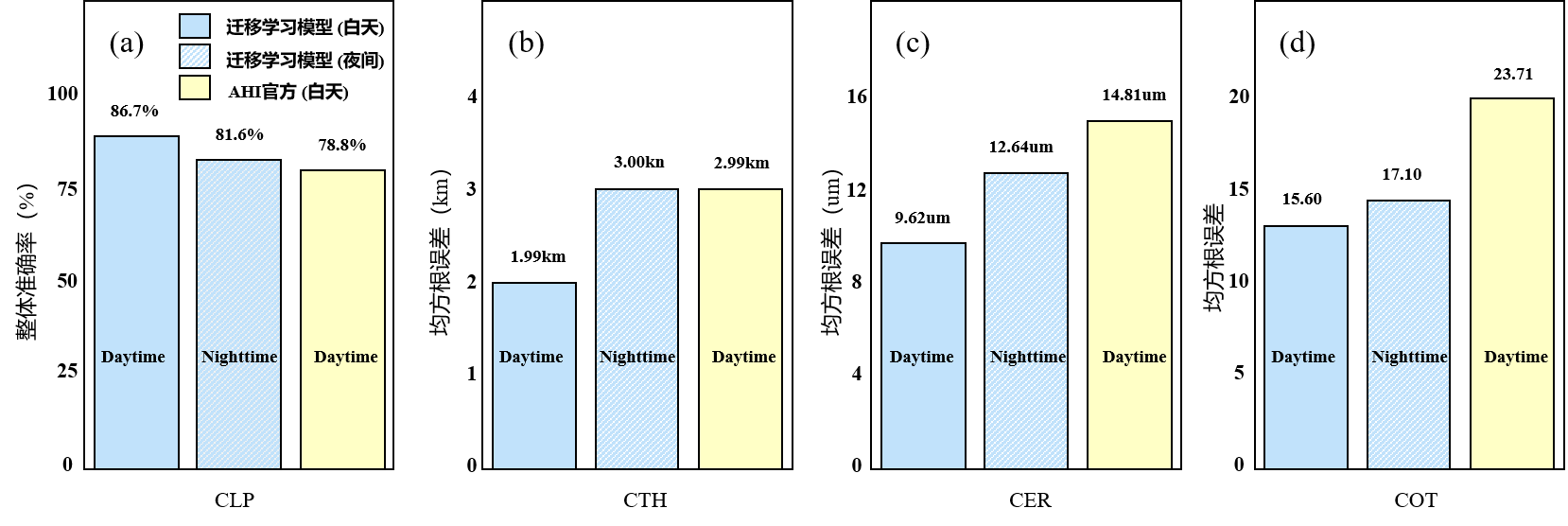

图4. 基于主动探测卫星遥感数据集检验AHI官方云产品和迁移学习模型反演的(a)CLP,(b)CTH♠️,(c)CER和(d)COT在白天和夜间的精度。

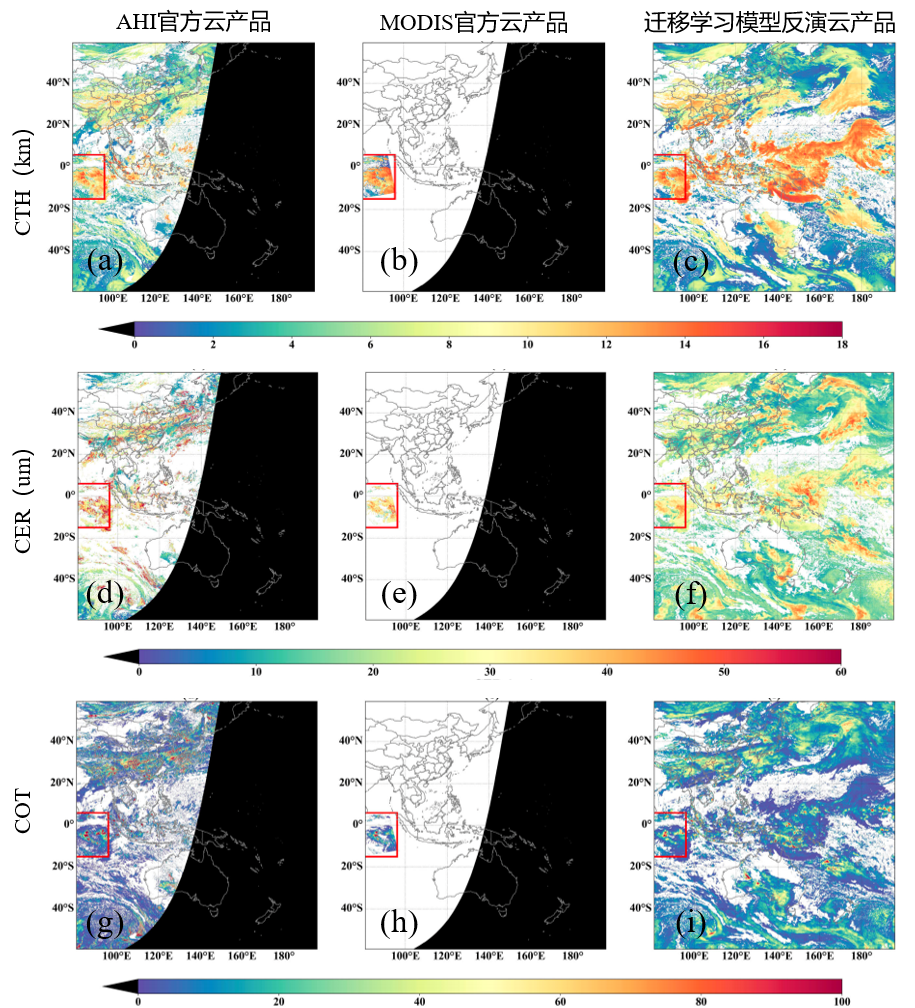

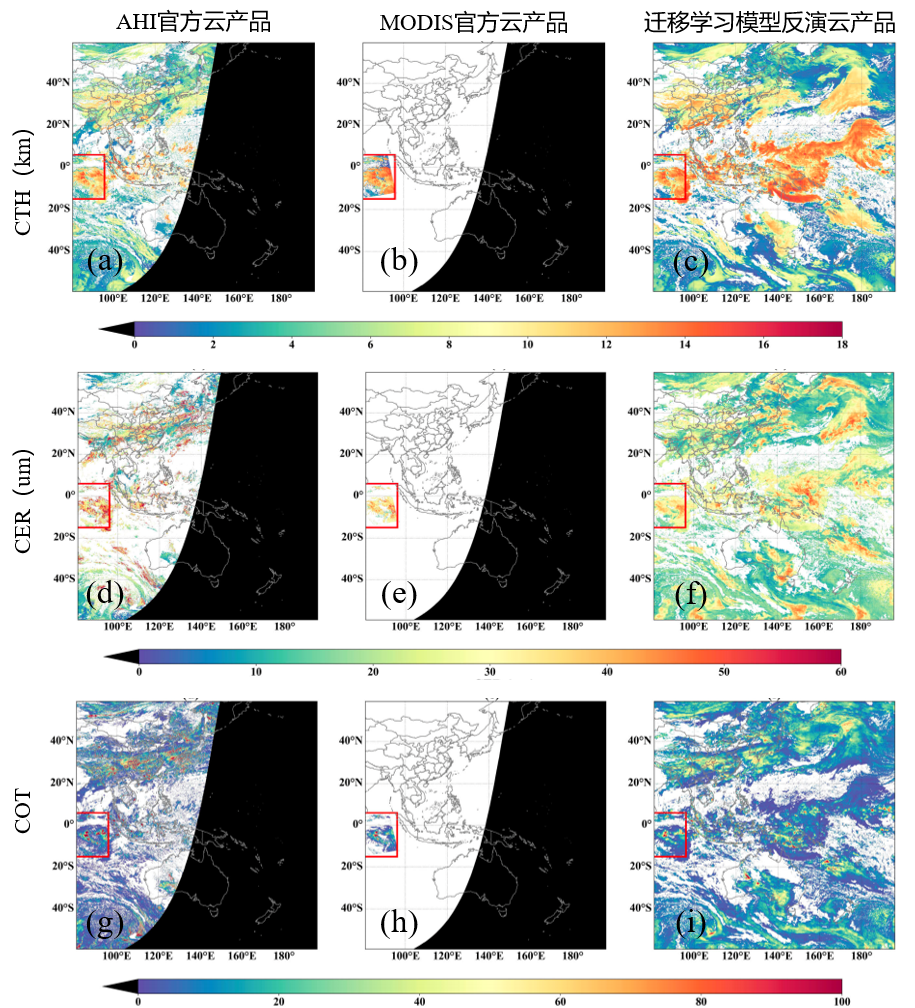

同样该迁移学习算法在新一代国产静止卫星FY4A/AGRI和日本静止卫星H8/AHI传感器上得到了很好的应用。为了客观评估迁移学习模型的反演效果,选取CALIPSO和CloudSat卫星官方发布的主动探测遥感数据集进行云产品的精度检验🪙。图4展示了该迁移学习算法在H8/AHI上的应用效果🤾♂️👩🏿,可以发现模型反演的云产品在白天的精度(CLP: 86.7%🤛🏻,CTH: 1.99 km🏃🏻♂️➡️, CER: 9.62 µm🕢,COT: 15.60)显著高于H8/AHI的官方云产品的精度(CLP: 78.8%,CTH: 2.99 km,CER: 14.81 µm☛,COT: 23.71),并且该模型在白天和夜间的精度(CLP: 81.6%🚠,CTH:3.00 km,CER: 12.64 µm🤴🏿,COT: 17.10 )相差不大🙎🏽。此外,从图5某个相同时刻下AHI官方云产品👩🏻✈️,MODIS官方云产品以及迁移学习模型反演的云物理特性产品空间分布来看,AHI官方云产品只提供白天云产品数据💅🍄,MODIS只提供小部分区域的云产品数据,而迁移学习模型不仅可以得到完整的全云盘云产品数据,并且其空间分布特征相比于AHI官方云产品也更加接近于MODIS官方云产品。综合,静止卫星全天时云遥感反演迁移学习算法在进行迁移训练后大大提升了模型的云反演能力𓀕,其反演的云产品精度不仅可达到极轨卫星MODIS的云产品精度水平,而且在白天和夜间具有稳定的反演能力。

图5. 同一时刻下AHI官方云产品👨🏼🦰,MODIS官方原产品和迁移学习模型反演的云物理特性空间分布(黑色区域为夜间)。

目前⏪👨🏼🚀,相关算法已成功应用在多颗静止卫星传感器上,并取得到了不错的反演效果。这充分说明了张峰团队发展的静止卫星云遥感反演算法具有广泛的适用性,也为构建更多的全天时、高精度、高频次、大范围的云物理参数遥感数据集提供了可能。未来🟠,随着人工智能技术的不断发展⛳️,希望可以利用最先进🛁、最前沿的技术继续改善深度学习云遥感反演算法,提升静止卫星云产品反演的精度🪑,📫,帮助人们更好地理解云在地气系统中起到的重要作用☂️。上述相关成果已发表在IEEE Transactions on Geoscience and Remote Sensing和Geophysical ResearchLetters杂志🚿🎽,通讯作者为万事娱乐的张峰教授,文章的第一作者分别是上海万事娱乐平台的学生赵志军🧑🏽✈️、李经纬🧑🏽🚀、郭斌以及博后童宣🏋🏿♀️。

论文信息:

Zhao, Z., Zhang, F*., Wu, Q., Li, Z., Tong, X., Li, J., & Han, W. (2023). Cloud identification and properties retrieval of the Fengyun-4A satellite using a ResUnet model. IEEE Transactions on Geoscience and Remote Sensing, 61,10.1109/TGRS.2023.3252023.

Li, J., Zhang, F*., Li, W., Tong, X., Pan, B., Li, J., Lin, H., Letu, H., & Mustafa, F. (2023). Transfer-learning-based approach to retrieve the cloud properties using diverse remote sensing datasets. IEEE Transactions on Geoscience and Remote Sensing, 61, 10.1109/TGRS.2023.3318374.

Guo, B., Zhang, F*., Li, W., & Zhao, Z. (2024). Cloud Classification by machine learning for Geostationary Radiation Imager. IEEE Transactions on Geoscience and Remote Sensing, 61, 10.1109/TGRS.2024.3353373.

Tong, X., Li, J., Zhang, F*., Li, W., Pan, B., Li, J., & Letu, H. (2023). The Deep‐Learning‐Based Fast Efficient Nighttime Retrieval of Thermodynamic Phase From Himawari‐8 AHI Measurements. Geophysical Research Letters, 50(11), https://doi. org/10.1029/2009JD012152.